Nvidia ha presentado Isaac GROOT N1, el primer modelo de base personalizable y abierto ideado para aportar habilidades generalizadas y razonamiento a los robots humanoides, además de mostrar el motor de física de código abierto para desarrollar robots Newton.

En el marco de la conferencia GTC 2025, el fundador y director ejecutivo de Nvidia, Jensen Huang, ha subrayado la importancia de la industria de la robótica, al tiempo que ha señalado que, para finales de esta década, el mundo tendrá un déficit de al menos 50 millones de trabajadores.

MIRA: PUBG abre su mundo: ahora podrás crear tus propios mapas y reglas

Teniendo todo ello en cuenta, Nvidia planea ofrecer un conjunto de tecnologías para entrenar, implementar, simular y probar la robótica de próxima generación. Por lo que, entre otras novedades, ha anunciado la disponibilidad de Isaac GROOT N1, el primer modelo de base abierto y personalizable para el razonamiento y las habilidades humanoides.

Tal y como ha detallado la tecnológica en un comunicado, GROOT N1 ya está disponible y es el primero de una familia de modelos personalizables que Nvidia capacitará previamente para su posterior uso por parte desarrolladores de robótica de todo el mundo.

En concreto, este modelo base presenta una arquitectura de sistema dual, inspirada en “los principios de la cognición humana”. Así, según ha detallado la compañía, el primer sistema (Sistema 1) es un modelo de acción de pensamiento rápido, que representa los reflejos o la intuición humana y que está entrenado con la plataforma Nvidia Omniverse.

Por su parte, el segundo sistema (Sistema 2) utiliza un modo de pensamiento lento para la toma de decisiones deliberada y metódica. Este sistema es capaz de razonar sobre su entorno y en base a las instrucciones recibidas para planificar acciones. Asimismo, Sistema 1 traduce estos planes ideados por Sistema 2 en movimientos robóticos precisos y continuos.

De esta forma, GROOT N1 permite generalizar tareas comunes, como agarrar, mover objetos a otros lugares o transferirlos de un brazo a otro. También permite realizar tareas de varios pasos que requieren un contexto extenso y una combinación de habilidades generales. Todo ello se puede aplicar a casos de uso como la manipulación de materiales en fábricas.

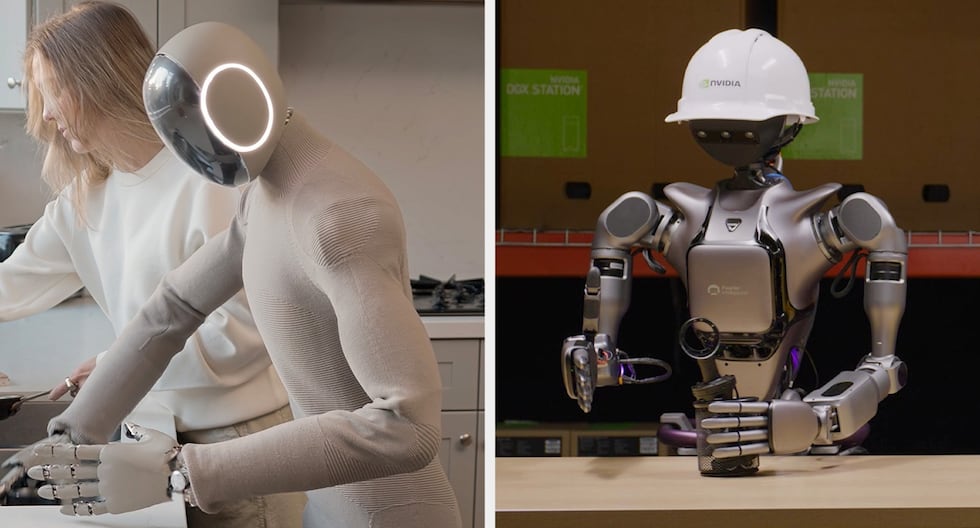

Además, este modelo destaca por ser personalizable, con lo que los desarrolladores pueden entrenar GROOT N1 con datos reales o sintéticos para que su robot humanoide lleve a cabo tareas específicas. Para mostrar las capacidades del modelo Isaac GROOT N1, Nvidia ha contado con el robot humanoide 1X, que ha realizado tareas domésticas de forma autónoma.

Los datos de entrenamiento y los escenarios de evaluación de tareas de GROOT N1 ya están disponibles para su descarga desde Hugging Face y GitHub. Asimismo, Nvidia ha señalado que el plano de Isaac GROOT para la generación de movimiento también está disponible como demo interactiva en el servicio build.nvidia.com y en GitHub.

MIRA: Con 25% de acero reciclado y un 70% de poliéster reutilizable, ¿es el Volvo EX30 el vehículo más ecoamigable en el Perú?

Motor de Física Newton para simulación robótica

Siguiendo esta línea, Nvidia también ha mostrado Newton, un motor de física de código abierto desarrollado junto con Google DeepMind y Disney Research, ideado para la simulación robótica, que permite que los robots aprendan a manejar tareas complejas con mayor precisión.

Este motor está basado en el framework Nvidia Wrap y será compatible con plataformas de simulación como MuJoCo de Google DeepMind y NVIDIA Isaac Lab. En concreto, con el desarrollo junto a Google DeepMind, se espera que las cargas de trabajo de aprendizaje automático robótico se aceleren en más de 70 veces.

Igualmente, Disney Research será uno de las primeras compañías en utilizar Newtron para su plataforma de personajes robóticos que impulsa a los robots de entretenimiento de próxima generación, como los droides BDX inspirados en Star Wars. No obstante, se espera que el motor de física Newton esté disponible a finales de este año.

Modelos de base Nvidia Cosmos

Además de todo ello, Nvidia ha lanzado los nuevos modelos de base Nvidia Cosmos, que presentan capacidades de razonamiento abiertas y personalizables para el desarrollo de IA física, con lo que ofrecen a los desarrolladores “un control sin precedentes sobre la generación del mundo”.

MIRA: Antiviral oral evita la muerte por el temible virus del Ébola en macacos rhesus infectados

Estos modelos, impulsados por las plataformas NVIDIA Omniverse y Cosmos, brindan a los desarrolladores motores de generación de datos sintéticos masivos y controlables para robots y vehículos autónomos posteriores al entrenamiento.

Por un lado, Nvidia ha presentado los modelos Cosmos Transfer, que permiten la ingerencia de entradas de vídeo estructuradas, como mapas de segmentación, mapas de profundidad, escaneos lídar o mapas de trayectoria, para generar salidas de vídeo fotorrealistas que se traducen en la generación de datos sintéticos controlables a gran escala.

Por otra parte, la tecnológica ha mostrado los modelos Cosmos Predict, que ya fueron anunciados en el marco del CES en enero. Estos modelos generan estados de mundos virtuales a partir de entradas multimodales como texto, imágenes o vídeo. De esta forma, permiten la generación multifotograma, prediciendo acciones intermedias o trayectorias de movimiento al recibir imágenes de entrada de inicio y fin, tal y como ha explicado la compañía.

Finalmente, Cosmos Reason es otros de los modelos presentados, también con capacidades de personalización, dispone de conciencia espaciotemporal y utiliza el razonamiento para comprender datos de vídeo y predecir los resultados de las interacciones en lenguaje natural.

Con todo ello, los modelos de Cosmos están disponibles en vista previa en el catálogo API de Nvidia y en Vertex AI Model Garden de Google Cloud. Asimismo, Cosmos Predict y Trasnfer están disponibles abiertamente en Hugging Gace y GitHub. Por su parte, Cosmos Reason está disponible en acceso anticipado.

“Así como los grandes modelos de lenguaje revolucionaron la IA generativa y agente, los modelos de base del mundo de Cosmos suponen un gran avance para la IA física”, ha sentenciado Jensen Huang.